Вчені змусили людей згадати те, чого вони ніколи не бачили: не обійшлося без штучного інтелекту

Дослідження вчених несподівано виявило, що якщо показати людям якісно підроблені відеокадри із римейків фільмів, яких насправді ніколи не існувало, то піддослідні починають пригадувати, що бачили їх та навіть порівнювати із оригіналами.

Про це йдеться у дослідження, що було опубліковане в журналі PLOS One. Вчені вважають, що це доводить те, наскільки легко можна "підсадити" людині спогади про її життя, яких ніколи не було.

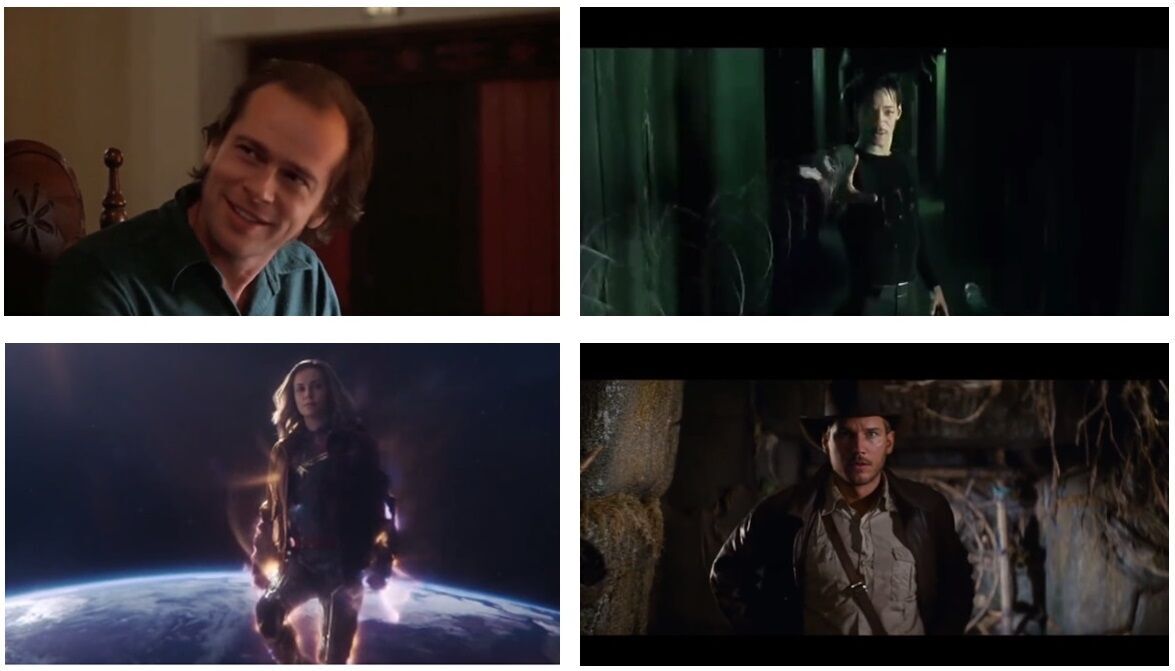

В межах дослідження, людям показували фрагменти фільмів, в яких використовувалася технологія діпфейків, коли штучний інтелект замінює справжнє обличчя актора на обличчя того актора, якого йому надали автори дослідження.

Так, 436 піддослідними показували неіснуючий ребут "Матриці", в якій роль Нео грав не Кіану Рівз, а Вілл Сміт, який, між іншим, і справді був конкурентом Рівза під час прослуховувань на роль. Також були показані уривки з "Сяйва" де замість Джека Ніколсона грав Бред Пітт, "Капітан Марвел" із Шарліз Терон заміть Брі Ларсон, а також "Індіана Джонс: У пошуках втраченого ковчега" із Крісом Праттом замість Гаррісона Форда.

Виявилося, що навіть коротких, але якісно зроблених відеофрагментів було достатньо, аби піддослідні почали вірити, що вони бачили цей фільм. Дехто з учасників експерименту навіть починав згадувати про те, які емоції викликав перегляд стрічки, а також чи була вона кращою за оригінал.

Разом із тим, автори експерименту закликають не драматизувати результати. На їхню думку, підмінити спогади людини можна не лише завдяки технології діпфейку.

"Діпфейки виявилися не більш ефективними у спотворенні пам'яті, ніж прості текстові описи", – йдеться в статті.

Тож, як зазначають вчені, діпфейки не є абсолютно необхідними для того, щоб обдурити когось і змусити прийняти фальшиві спогади.

"Ми не повинні робити поспішних висновків про похмуре майбутнє, ґрунтуючись на наших страхах перед новими технологіями", – сказала провідна авторка статті, дослідниця дезінформації в Університетському коледжі Корка в Ірландії Джилліан Мерфі.

В інтерв'ю The Daily Beast вона визнала, що існує цілком реальна шкода від діпфейків, "але ми завжди повинні збирати докази цієї шкоди, перш ніж поспішати вирішувати проблеми, про існування яких ми щойно здогадалися".

В середньому 49% учасників були обмануті підробленими відео, ще 41% з цієї групи стверджував, що ремейк "Капітана Марвела" був кращим за оригінал.

"Наші висновки не викликають особливого занепокоєння, оскільки вони не свідчать про якусь унікальну загрозу, яку становлять діпфейки порівняно з існуючими формами дезінформації", – резюмувала Мерфі.

Раніше OBOZREVATEL розповідав про те, що телеканал СТБ втрапив у скандал, "приліпивши" російському актору обличчя українського колеги.

Підписуйтесь на канали OBOZREVATEL в Telegram, Viber і Threads, щоб бути в курсі останніх подій.